Kovaryans matrisi

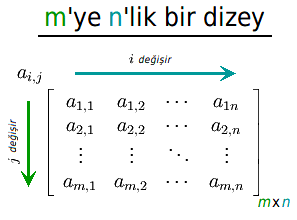

İstatistik'te, kovaryans matrisi (veya varyans-kovaryans matrisi veya varyans matrisi), rassal vektörlerin elemanları arasındaki kovaryansları içeren matristir. Kovaryans matrisi, skaler-değerli rassal değişkenler için var olan varyans kavramının çok boyutlu durumlara genelleştirilmesidir.

Tanımlama

Eğer şu sütun vektörü içine

giren değişkenlerin her biri sonlu varyansı olan rassal değişken iseler, o halde (i, j) elemanı bir kovaryans olan matris Σ kovaryans matrisi olur:

burada

X vektöründeki iinci değişkenin beklenen değeri olur. Diğer bir deyişle, elimizde şu vardır:

Bu matrisin tersi' olan matris, yani , ters kovaryans matrisi ya da konsantrasyon matrisi veya kesinlik matrisi olarak anılır.[1] Bu "ters kovaryans matrisi"nın elemanları kısmî korelasyonlar veya kısmî varyanslara yapılan atıflarla açıklanabilirler.

Kulanılan notasyonlarda ve isimlendirmede çatışmalar

İstatistik literatüründe bu kavram için isimlendirme tek-örnek olarak degil, değişik şekillerde yapılmaktadır:

- Amerikan olasılık teoricisi William Feller'in takipcileri bu matrise X rassal vektörünün Varyans matrisi adını verirler; çünkü bu tek-boyutlu varyans kavramının doğal olarak daha yüksek boyutlarda genelleştirilmesidir.

- Diğerleri bu matris covaryans matris olarak isimlendirirler, cunku bu matrisinin skaler parcalarinin arasinda olan kovaryanslarin matrisidir.

Böylece

Ama iki vektör arasındaki karşılıklı-kovaryans için notasyon sadece tek bir standarta uyar:

Özel var notasyonu William Feller'in An Introduction to Probability Theory and Its Applications, adlı eserinde kullanılır; ama her iki alternatif notasyon da standart olarak kullanılmaktadır; bu iki değişik başta açılanıp öğrenilmekte ve anlayıp kullananlar için bir anlam karışıklığına neden olmamaktadır.

matrisi ise çok zaman varyans-kovaryans matris olarak anılır; çünkü bu matrisin diagonal elemanları varyanslardır.

Özellikleri

X p-boyutlu bir rassal degisken ve Y q-boyutlu bir rassal degisken için ve , olarak verilmisse, su temel ozellikler bulunmaktadır:

- bir positif semi-definit matrisdir.

- Eger p = q ise o zaman

- Eğer ve birbirlerinden bağımsız iseler, o halde

burada ve rassal p×1 derecede vektör, rassal q×1 derecede vektör, ise q×1 derecede vektör, ve (q×p) dereceli matrislerdir.

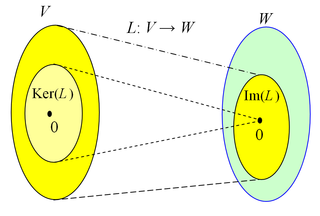

Bu kovaryans matrisi değişik alanlarda uygulamaları bulunan bir matematik araçtır. Bu matrisden bir transformayon matrisi çıkartılabilir ve bu veride bulunan bütün korelasyonların elimine edilebilmesini mümkun kılar. Bu transformasyon matrisi bularak tüm korelasyonları elimine etme analizine temel bileşenler ("principal components) analizi adı verilir.

Bir doğrusal operatör olarak

Hangi matrisler kovaryans matrisleridir?

Uygun bir kovaryans matrisi nasıl bulunur

Bazı uygulamalarda (örneğin sadece kısmen gözumlenen verilerden veri modeli kurmada) bir verilmiş belirli (gözümlenen kovaryanslardan oluşmuş) bir simetrik matrise "en yakın" kovaryans matrisi bulmak istenebilir. 2002 yılında, Higham [2] "ağırlıklı Frobenius normu" kullanarak en yakınlılık kavramını formalize etmiştir ve böylece en yakın kovaryans matrisi bulmak için gereken yöntemi vermistir.

Kompleks rassal vektorler

Kestirim

Bir çoklu değişirli normal dağılım için kovaryans matrisinin maksimum-olabilirlilik kestrimcisininin elde edilmesi, belki çok zeki bir ince tranformasyon ile kolayca yapılabilir. Bakın kovaryans matrisleri kestimi

Olasılık yoğunluk fonksiyonu

Bir tane korelasyonlu rassal değişken dizisi için olasılık yoğunluk fonksiyonu, n dereceli bir Gauss-tipi vektor olan birlesik olasılık fonksiyonu olup Maksimum olabilirlik maddesinde aciklanmaktadir.

Dipnotlar

Ayrıca bakınız

- Kovaryans matrisleri kestrimi

- Çok değişirli istatistik

- Örneklem kovaryans matrisi

- Gramian matrisi

- eigendeğer dekompozisyon

Dış bağlantılar

- İngilizce Wikipedia "Covariance matrix" maddesi 15 Şubat 2010 tarihinde Wayback Machine sitesinde arşivlendi. (İngilizce) (Erişme:17.12.2009)

- Weisstein, Eric W., "Covariance Matrix", MathWorld--A Wolfram Web Resource26 Temmuz 2019 tarihinde Wayback Machine sitesinde arşivlendi. (İngilizce) (Erişme:17.12.2009)

- N.G. van Kampen, (1981) Stochastic processes in physics and chemistry. New York: North-Holland, (İngilizce)

![{\displaystyle \Sigma ={\begin{bmatrix}\mathrm {E} [(X_{1}-\mu _{1})(X_{1}-\mu _{1})]&\mathrm {E} [(X_{1}-\mu _{1})(X_{2}-\mu _{2})]&\cdots &\mathrm {E} [(X_{1}-\mu _{1})(X_{n}-\mu _{n})]\\\\\mathrm {E} [(X_{2}-\mu _{2})(X_{1}-\mu _{1})]&\mathrm {E} [(X_{2}-\mu _{2})(X_{2}-\mu _{2})]&\cdots &\mathrm {E} [(X_{2}-\mu _{2})(X_{n}-\mu _{n})]\\\\\vdots &\vdots &\ddots &\vdots \\\\\mathrm {E} [(X_{n}-\mu _{n})(X_{1}-\mu _{1})]&\mathrm {E} [(X_{n}-\mu _{n})(X_{2}-\mu _{2})]&\cdots &\mathrm {E} [(X_{n}-\mu _{n})(X_{n}-\mu _{n})]\end{bmatrix}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4beea93452c5b3887191b930c55a68dcc822dae5)

![{\displaystyle \operatorname {var} ({\textbf {X}})=\operatorname {cov} ({\textbf {X}})=\mathrm {E} \left[({\textbf {X}}-\mathrm {E} [{\textbf {X}}])({\textbf {X}}-\mathrm {E} [{\textbf {X}}])^{\top }\right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9045af380fe7255bc13d8dc43ba4ba22928c030a)

![{\displaystyle \operatorname {cov} ({\textbf {X}},{\textbf {Y}})=\mathrm {E} \left[({\textbf {X}}-\mathrm {E} [{\textbf {X}}])({\textbf {Y}}-\mathrm {E} [{\textbf {Y}}])^{\top }\right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4caf5a2077c12509d836a6cd80e9c33ee57a15a5)

![{\displaystyle \Sigma =\mathrm {E} \left[\left({\textbf {X}}-\mathrm {E} [{\textbf {X}}]\right)\left({\textbf {X}}-\mathrm {E} [{\textbf {X}}]\right)^{\top }\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a7a9f117f4cfd23a38f35a88121160de3e5d3ef5)